9. 컴퓨터 비전

1. OpenCV를 이용한 이미지 뷰어 구현

OpenCV는 이미지 처리와 컴퓨터 비전 분야에서 가장 많이 사용되는 라이브러리 중 하나입니다. 아래 예제는 OpenCV만을 사용하여 기본적인 이미지 뷰어를 구현한 코드입니다. 주요 기능은 다음과 같습니다.

- Crop (자르기): 이미지의 특정 영역만 선택하여 보여줌

- 흑백화 (Grayscale Conversion): 컬러 이미지를 흑백 이미지로 변환

- Zoom (확대/축소): 이미지의 크기를 변경하여 확대 혹은 축소함

import cv2

# 이미지 파일 경로 설정

image_path = 'sample.jpg'

img = cv2.imread(image_path)

# 줌(확대/축소) 함수: scale 값을 조절하여 이미지 크기를 변경

def zoom_image(image, scale=1.2):

width = int(image.shape[1] * scale)

height = int(image.shape[0] * scale)

return cv2.resize(image, (width, height))

# 크롭 함수: (x, y) 좌표와 폭, 높이를 인자로 받아 이미지의 일부분을 추출

def crop_image(image, x, y, w, h):

return image[y:y+h, x:x+w]

# 흑백 변환 함수

def convert_to_gray(image):

return cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 간단한 사용자 인터페이스 구현: 키 입력에 따라 기능 선택

while True:

cv2.imshow("Image Viewer", img)

key = cv2.waitKey(0) & 0xFF

if key == ord('q'): # 'q'를 누르면 종료

break

elif key == ord('g'): # 'g'를 누르면 흑백 변환

img = convert_to_gray(img)

elif key == ord('z'): # 'z'를 누르면 이미지 확대 (scale 조절 가능)

img = zoom_image(img, scale=1.5)

elif key == ord('c'): # 'c'를 누르면 중앙 영역을 크롭 (예시로 100x100 영역)

h, w = img.shape[:2]

img = crop_image(img, w//2 - 50, h//2 - 50, 100, 100)

cv2.destroyAllWindows()

추가 설명:

cv2.imread()를 통해 이미지를 불러오고,cv2.imshow()로 화면에 표시합니다.cv2.waitKey()는 키 입력을 기다리며, 입력된 키에 따라 특정 함수를 호출합니다.- 실제 프로젝트에서는 GUI 라이브러리(예: Tkinter, PyQt 등)와 연동하여 더 풍부한 사용자 경험을 제공할 수 있습니다.

2. 딥러닝 발달 이전의 사물 감지 방법

딥러닝이 널리 활용되기 전, 객체(사물) 감지에는 주로 전통적 컴퓨터 비전 기법이 사용되었습니다. 대표적인 방법은 다음과 같습니다.

-

Haar Cascade (Viola-Jones 알고리즘):

- 원리: 사전에 학습된 Haar-like 특징을 이용하여 이미지 내에서 얼굴이나 다른 객체를 빠르게 검출

- 특징: 매우 빠른 검출 속도 때문에 실시간 애플리케이션(예: 얼굴 검출)에 많이 사용됨

- 단점: 다양한 조명과 각도에 대해 강건하지 못할 수 있음

-

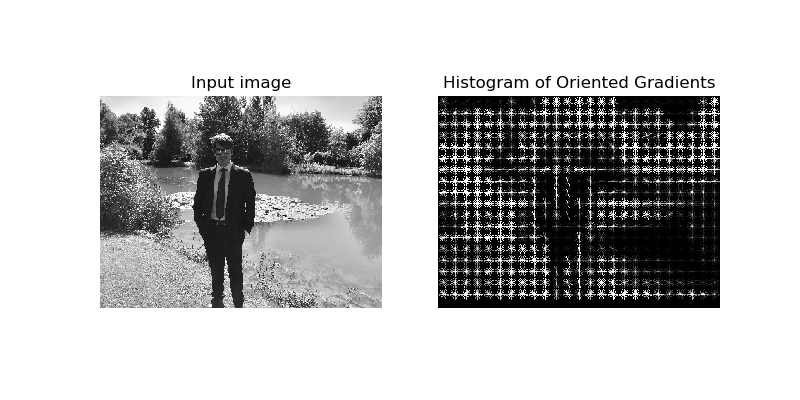

HOG (Histogram of Oriented Gradients) + SVM:

- 원리: 이미지의 경계 방향 정보를 히스토그램으로 나타내어 객체의 모양을 기술하고, Support Vector Machine(SVM)을 이용하여 객체 분류

- 특징: 보행자 검출 등에서 효과적이며, 비교적 단순한 특성 기반 접근 방식임

- 단점: 복잡한 배경이나 다양한 스케일에 대해 한계가 있음

-

SIFT / SURF:

- 원리: 이미지의 특징점을 추출하여 객체의 중요한 부분(코너, 에지 등)을 찾아내고, 이를 기반으로 객체를 인식

- 특징: 회전, 스케일 변화에 강하며, 특징 매칭을 통해 물체를 검출할 수 있음

- 단점: 계산량이 많고, 실시간 응용에는 부적합

3. Faster R-CNN의 장단점

Faster R-CNN은 2단계 접근 방식(two-stage detector)으로, 먼저 Region Proposal Network(RPN)을 사용해 후보 영역을 생성한 후, 이 영역에 대해 분류와 경계 상자 회귀를 수행합니다.

장점

- 높은 정확도: RPN이 객체가 있을 법한 후보 영역을 효과적으로 생성하여 정밀한 객체 감지가 가능함

- 세밀한 바운딩 박스 예측: 후보 영역에 대해 두 번째 네트워크가 세부 조정을 하므로, 위치와 크기 예측에서 높은 정확도를 보임

단점

- 실시간 처리 어려움: 복잡한 네트워크 구조와 다단계 처리로 인해 추론 속도가 상대적으로 느림

- 구현 및 튜닝 난이도: 여러 단계의 학습 과정이 요구되어 파라미터 튜닝과 최적화가 어렵다

4. dlib이란?

dlib은 C++로 작성된 머신러닝 및 컴퓨터 비전 라이브러리이며, 파이썬 인터페이스도 제공하여 손쉽게 사용할 수 있습니다.

- 주요 기능: 얼굴 검출, 얼굴 랜드마크 추출, 객체 추적, 선형/비선형 회귀 등

- 특징:

- 가볍고 빠르며, 학습과 추론 모두에서 효율적

- 연구 및 실제 응용에서 많이 활용되며, 특히 얼굴 관련 응용에 강점을 보임

5. YOLO의 장단점

**YOLO (You Only Look Once)**는 단일 신경망을 통해 이미지 전체에서 객체의 위치와 클래스를 동시에 예측하는 단일 단계 접근 방식(single-shot detector)입니다.

장점

- 실시간 성능: 한 번의 순전파로 모든 예측을 수행하기 때문에 매우 빠르며, 실시간 애플리케이션에 적합함

- 전역 문맥 활용: 전체 이미지를 한 번에 고려하여 객체 간의 상호관계를 파악할 수 있음

단점

- 작은 객체 감지의 한계: 그리드 기반 접근으로 인해 작은 객체나 밀집된 객체 감지에는 어려움이 있음

- 정밀도 문제: 두 단계 접근 방식(Faster R-CNN 등)과 비교할 때, 일부 상황에서 정확도가 다소 떨어질 수 있음

6. 선호하는 Object Detection 알고리즘: YOLO

개인적으로 YOLO를 선호하는 이유는 다음과 같습니다.

-

알고리즘 개요:

- 이미지를 고정된 그리드로 나누고, 각 셀에서 바운딩 박스와 클래스 확률을 예측함

- 단일 신경망 구조로 빠른 추론 속도를 달성

-

장점:

- 속도: 실시간 객체 감지에 매우 효과적임

- 구조 단순성: 한 번의 순전파로 모든 작업을 수행하므로, 구현과 튜닝이 비교적 쉬움

-

단점:

- 세밀한 감지 한계: 작은 객체나 복잡한 배경에서는 성능 저하가 발생할 수 있음

- 정밀도: 특정 상황에서는 후보 영역을 세분화하는 방식에 비해 정확도가 낮을 수 있음

7. 이후 등장한 더 우수한 알고리즘

딥러닝 기술의 발전과 함께 객체 감지 알고리즘도 크게 발전했습니다. 대표적인 최신 알고리즘은 다음과 같습니다.

-

DETR (Detection Transformer):

- 특징: Transformer 기반의 접근 방식으로, End-to-End 학습이 가능하며, 복잡한 객체 간의 관계를 효과적으로 모델링

- 장점: 후보 영역 생성 단계가 필요 없고, 전체 이미지를 한 번에 처리

-

EfficientDet:

- 특징: 효율성과 정확도 사이의 균형을 맞춘 모델로, 스케일러블한 아키텍처 설계로 다양한 환경에서 좋은 성능을 보임

- 장점: 적은 계산량으로 높은 성능을 달성할 수 있음

또한, YOLO 시리즈의 최신 버전(예: YOLOv5, YOLOv7, YOLOv8)도 지속적으로 개선되어 다양한 응용 분야에서 활용되고 있습니다.

8. Average Pooling vs Max Pooling

Pooling은 CNN에서 특징 맵의 공간적 크기를 줄여 계산량을 감소시키고, 특징의 요약 정보를 제공하는 역할을 합니다.

-

Average Pooling:

- 원리: 풀링 영역 내의 모든 픽셀 값의 평균을 계산

- 특징: 노이즈를 줄이고 부드러운 특징 맵을 생성하며, 전반적인 정보 분포를 반영

-

Max Pooling:

- 원리: 풀링 영역 내의 최댓값을 선택

- 특징: 중요한 활성화 값(특징)을 강조하여, 경계나 특징이 두드러지게 표현됨

- 사용 이유: 중요한 특징을 보존하여 모델의 표현력을 높이는 데 유리함

9. Deep 네트워크: 깊이가 깊을수록 좋은가? 언제까지 유효할까?

-

장점:

- 네트워크 깊이가 깊어지면, 저수준부터 고수준까지의 복잡한 특징을 계층적으로 학습할 수 있음

- 복잡한 데이터의 패턴과 추상적 정보를 효과적으로 추출 가능

-

한계 및 고려사항:

- 기울기 소실/폭주 문제: 네트워크가 너무 깊으면 역전파 과정에서 기울기가 소실되거나 폭주하는 문제가 발생할 수 있음

- 과적합 위험: 파라미터 수가 증가하면 학습 데이터에 과도하게 맞춰져 일반화 성능이 떨어질 위험이 있음

- 계산 비용: 깊은 네트워크는 학습 및 추론 시 계산 자원과 시간이 많이 소요됨

- 해결책: Residual Connection, Batch Normalization 등 기법을 사용하여 깊은 네트워크의 단점을 보완

10. Residual Network (ResNet)와 Ensemble 관점

ResNet은 깊은 네트워크 학습에서 나타나는 기울기 소실 문제를 해결하기 위해 도입된 skip connection(잔차 연결) 개념이 핵심입니다.

-

동작 원리:

- 각 블록에서 입력을 그대로 다음 블록에 더해주어, 네트워크가 학습하기 어려운 항(예: 0에 가까운 변화)을 쉽게 건너뛰도록 함

- 이로 인해 매우 깊은 네트워크도 효과적으로 학습이 가능해짐

-

Ensemble 해석:

- 일부 연구에서는 Residual Block들이 여러 얕은 네트워크들의 집합처럼 작동하여, 일종의 앙상블 효과를 낸다고 해석하기도 함

- 각각의 블록이 부분적으로 학습된 표현을 제공하여 최종 결합 시 강건한 예측을 도출

11. CAM (Class Activation Map)

CAM은 CNN이 특정 클래스에 대해 어떤 이미지 영역에 주목하는지 시각화하는 기법입니다.

-

원리:

- 마지막 합성곱 층의 특징 맵과 분류기(fully connected layer)의 가중치를 활용하여, 클래스별로 중요한 영역을 산출

- 결과적으로 모델의 결정 근거를 설명하는 데 도움을 줌

-

활용:

- 모델 해석 및 디버깅

- 의료 영상, 자율주행 등에서 모델의 주목 영역을 확인하여 신뢰성을 높임

12. Localization (객체 위치 파악)

Localization은 이미지 내에서 객체의 위치와 크기를 찾는 작업을 의미합니다.

-

주요 방법:

- 바운딩 박스: 객체를 둘러싸는 사각형으로 위치와 크기를 표시

- 세그멘테이션 마스크: 객체의 형태를 픽셀 단위로 정확하게 표현

-

응용 분야:

- 객체 감지, 얼굴 검출, 자율주행 자동차의 객체 인식 등

13. 자율주행 자동차의 원리

자율주행 자동차는 여러 센서를 활용하여 주변 환경을 인식하고, 주행 경로를 계획하여 안전하게 이동합니다.

-

센서 융합:

- 카메라: 도로, 표지판, 차선 등 시각 정보를 수집

- LiDAR 및 레이더: 물체와의 거리, 속도, 3차원 형태 정보를 제공

- 초음파 센서: 근접 물체 탐지

-

데이터 처리:

- 수집된 센서 데이터를 실시간으로 처리하여 객체 감지, 세그멘테이션, 추적 등의 작업 수행

- 딥러닝 모델(CNN, RNN, Transformer 등)을 이용하여 주행 경로 예측 및 제어

-

통합 제어:

- 인지한 정보를 바탕으로 경로 계획, 속도 제어, 회피 동작 등 안전 주행을 위한 의사 결정

14. Semantic Segmentation

Semantic Segmentation은 이미지의 각 픽셀에 대해 클래스 라벨을 할당하여, 이미지 내 객체의 경계를 보다 정밀하게 구분하는 작업입니다.

-

특징:

- 픽셀 단위의 정밀한 객체 분할

- 도로, 건물, 사람 등 다양한 객체를 동시에 구분할 수 있음

-

응용:

- 자율주행, 의료 영상 분석, 장면 이해 등

15. Visual Question Answering (VQA)

Visual Q&A는 이미지와 자연어 질문을 결합하여, 이미지의 내용을 이해하고 그에 맞는 답변을 생성하는 문제입니다.

-

구성 요소:

- 이미지 인코더: CNN 등을 사용해 이미지의 특징을 추출

- 텍스트 인코더: RNN, LSTM, Transformer 등을 사용해 질문을 임베딩

- 멀티모달 융합: 이미지와 텍스트 정보를 결합하여 답변을 생성

-

도전 과제:

- 두 모달리티(시각, 언어) 간의 효과적인 정보 융합과 해석

16. Image Captioning

Image Captioning은 이미지의 내용을 설명하는 자연어 문장을 생성하는 작업입니다.

-

프로세스:

- 특징 추출: CNN을 통해 이미지의 중요한 특징을 추출

- 문장 생성: 추출된 특징을 기반으로 RNN, LSTM, 또는 Transformer가 문장을 생성

- 학습: 이미지-문장 쌍 데이터셋을 통해 end-to-end 방식으로 학습

-

응용 분야:

- 시각 장애인 보조, 자동 콘텐츠 생성 등

17. Fully Connected Layer (FC Layer)의 기능

Fully Connected Layer는 CNN의 마지막 단계에서 추출된 특징들을 종합하여 최종 분류나 회귀 결과를 도출하는 역할을 합니다.

-

역할:

- 모든 입력 뉴런과 출력을 완전하게 연결하여, 다양한 특징을 조합

- 복잡한 비선형 관계를 학습하여 최종 예측에 기여

-

특징:

- 일반적으로 높은 차원의 데이터를 저차원으로 압축하는 역할

- 마지막 소프트맥스(또는 회귀 함수)와 결합되어 최종 결과 생성

18. Neural Style Transfer

Neural Style Transfer는 한 이미지의 스타일(색채, 질감, 브러시 스트로크 등)을 다른 이미지의 콘텐츠에 적용하는 기술입니다.

-

동작 과정:

- 특징 추출: CNN을 통해 콘텐츠 이미지와 스타일 이미지의 특징 맵을 추출

- 손실 함수 설정: 콘텐츠 손실과 스타일 손실을 동시에 최소화하도록 목표를 설정

- 최적화: 초기 노이즈 이미지에서 두 손실의 가중합을 최소화하여 최종 이미지를 생성

-

응용:

- 예술적 이미지 변환, 이미지 필터 효과, 창의적 콘텐츠 생성 등

19. Convolutional Neural Network (CNN)의 개념

CNN은 이미지, 영상, 시계열 데이터 등 2차원 혹은 3차원 데이터 처리에 최적화된 신경망 구조입니다.

-

주요 구성 요소:

- 합성곱 계층 (Convolutional Layer): 지역적 패턴을 인식하고, 가중치 공유를 통해 파라미터 수를 줄임

- 활성화 함수: ReLU, Leaky ReLU 등 비선형 활성화를 적용하여 표현력 향상

- 풀링 계층 (Pooling Layer): 공간적 차원을 축소하여 계산 효율과 불변성(translation invariance)을 제공

- 완전 연결 계층 (FC Layer): 최종 분류나 회귀를 위해 추출된 특징을 종합

-

장점:

- 지역적 특성(로컬 패턴)을 효과적으로 학습

- 파라미터 공유로 인해 MLP보다 훨씬 효율적

20. CNN이 MLP보다 뛰어난 이유

CNN은 이미지와 같이 공간적 구조가 중요한 데이터에 대해 다음과 같은 장점을 가집니다.

-

지역적 연결 (Local Connectivity):

- 인접 픽셀 간의 관계를 고려하여 특징을 추출

- MLP는 모든 입력 노드와 완전 연결되어 비효율적임

-

가중치 공유 (Weight Sharing):

- 동일한 필터가 전체 이미지에 적용되어 파라미터 수를 크게 줄임

- 이는 학습 속도와 일반화 성능에 긍정적 영향을 줌

-

계층적 특징 추출:

- 낮은 계층은 에지나 텍스처, 높은 계층은 객체의 구성 요소를 학습

- MLP는 이러한 계층적 구조를 자연스럽게 형성하기 어려움

21. CNN의 파라미터 개수 계산

합성곱 계층의 파라미터 수는 다음과 같이 계산할 수 있습니다.

-

계산 공식:

파라미터 수 = (커널 높이 × 커널 너비 × 입력 채널 수 + 1 [바이어스]) × 필터 수 -

예시:

-

만약 3×3 커널, 입력 채널 32, 필터 64개라면:

(3×3×32 + 1) × 64 = (288 + 1) × 64 = 289 × 64 = 18496

-

-

주의점:

- 각 층마다 계산한 후, 전체 네트워크의 파라미터 수를 합산합니다.

22. 주어진 CNN과 동일한 MLP를 구성할 수 있는가?

이론적으로는 MLP(완전 연결 신경망)도 임의의 함수를 근사할 수 있으나, 실제로는 다음과 같은 이유로 비효율적입니다.

-

파라미터 수의 폭증:

- CNN은 지역적 특징을 추출하기 위해 가중치 공유를 활용하지만, MLP는 입력의 모든 요소를 연결해야 하므로 파라미터 수가 기하급수적으로 증가함

-

공간적 정보 활용 부족:

- 이미지와 같이 구조적인 데이터를 처리할 때, MLP는 인접 픽셀 간의 관계를 효과적으로 반영하지 못함

-

실용성:

- 동일한 역할을 수행하기 위해 필요한 MLP의 규모는 계산 비용과 메모리 사용 측면에서 비현실적입니다.

23. 왜 풀링 시 Max Pooling을 사용하는가?

Max Pooling은 영역 내 가장 큰 활성화 값을 선택함으로써 다음과 같은 효과를 냅니다.

-

주요 특징 보존:

- 중요한 특징(높은 활성화 값)을 그대로 유지하여, 노이즈나 불필요한 정보는 제거함

-

불변성 강화:

- 작은 위치 변화에 대해서도 중요한 특징이 유지되므로, 모델의 견고함(robustness)을 높임

-

계산 효율성:

- 단순히 최대값만을 선택하기 때문에 계산 비용이 적고, 모델 학습에 긍정적인 영향을 줌

24. 시퀀스 데이터에 CNN 적용 가능 여부

CNN은 반드시 이미지와 같은 2차원 데이터에만 국한되지 않습니다. 1D 컨볼루션을 적용하여 시퀀스 데이터에도 효과적으로 사용할 수 있습니다.

-

텍스트 처리:

- 문장의 단어 임베딩 시퀀스에 1D CNN을 적용하여 n-gram 특징을 추출할 수 있음

- 이는 감정 분석, 문장 분류 등에서 사용됨

-

음성 신호:

- 음성 신호와 같은 시계열 데이터에 대해 1D CNN을 적용하여 특징을 추출하고, 이후 RNN이나 Transformer와 결합하여 처리

-

장점:

- CNN은 병렬 처리에 유리하여 시퀀스 데이터를 빠르게 처리할 수 있음

- 지역적 패턴(예: 연속된 단어나 소리의 패턴)을 효과적으로 학습함